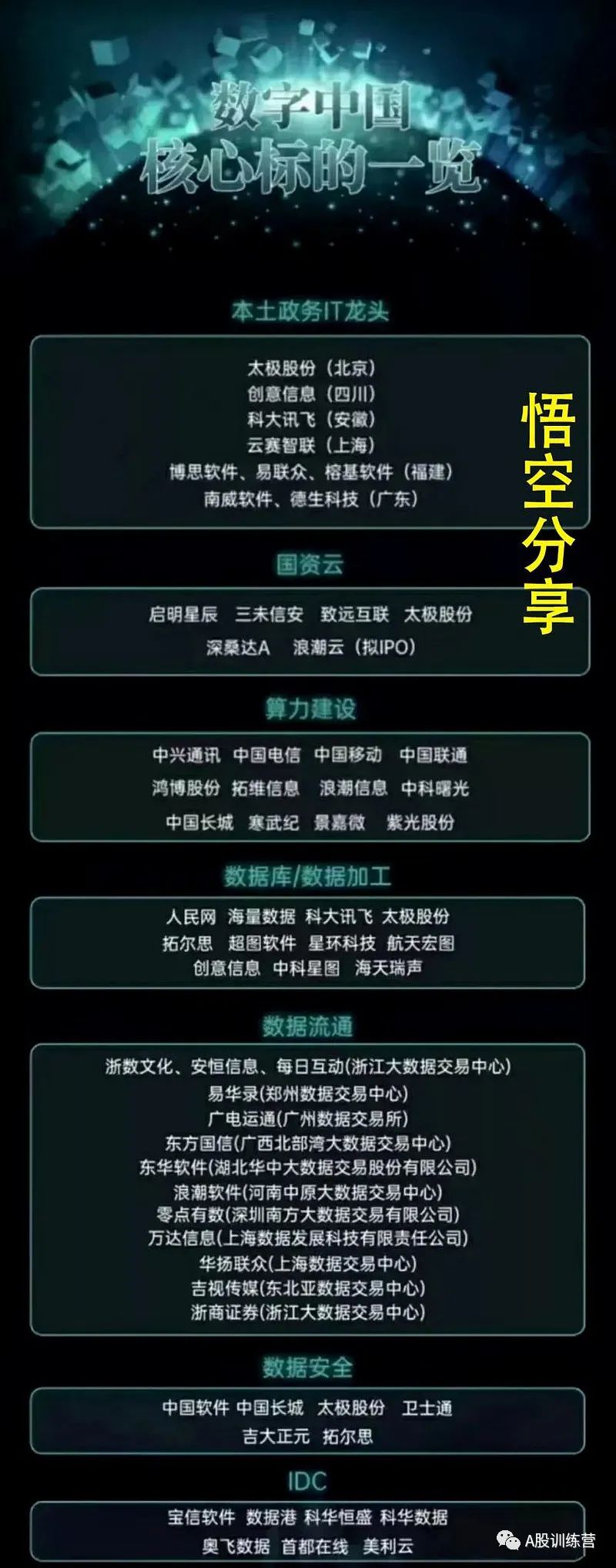

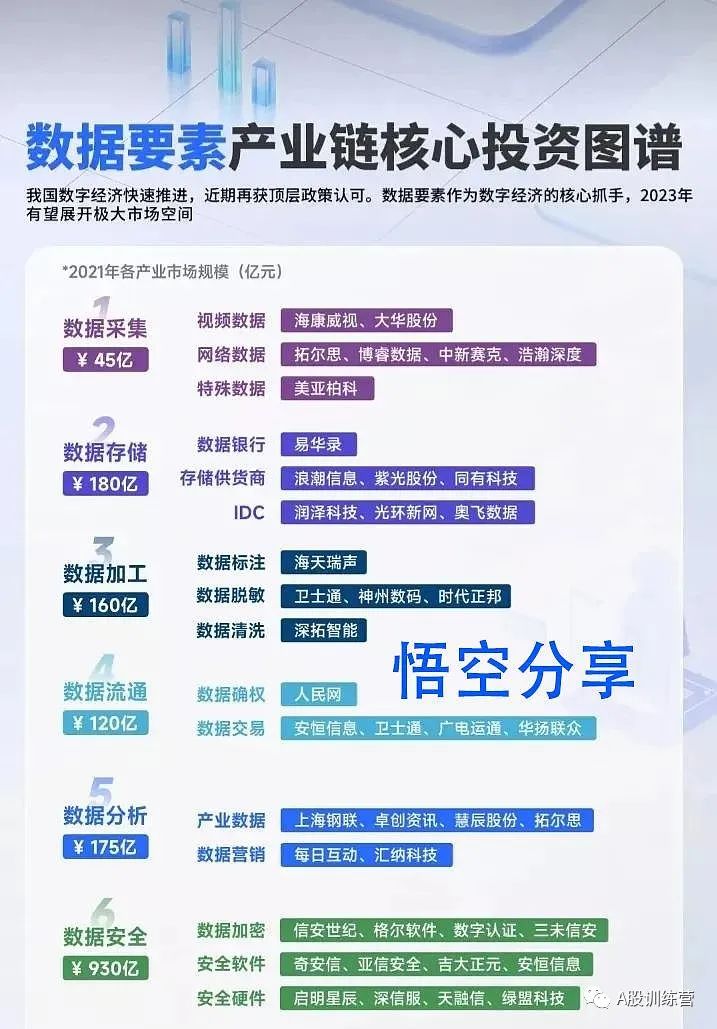

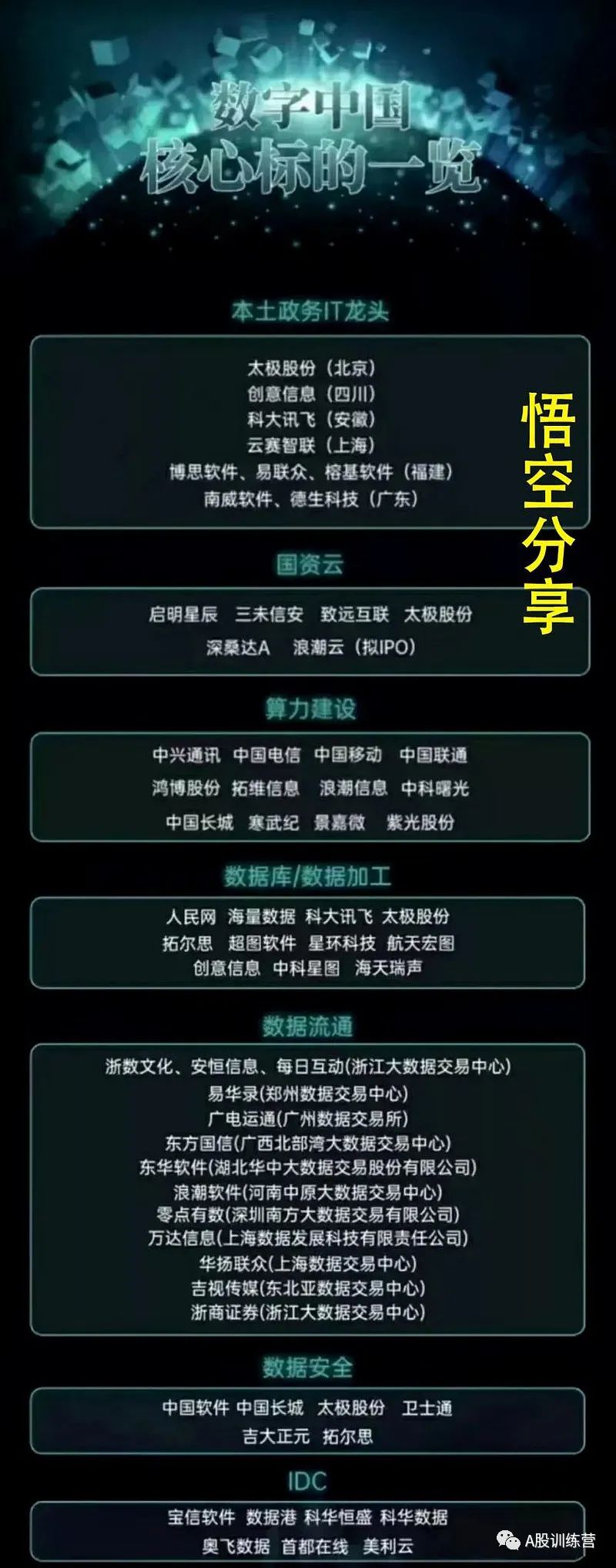

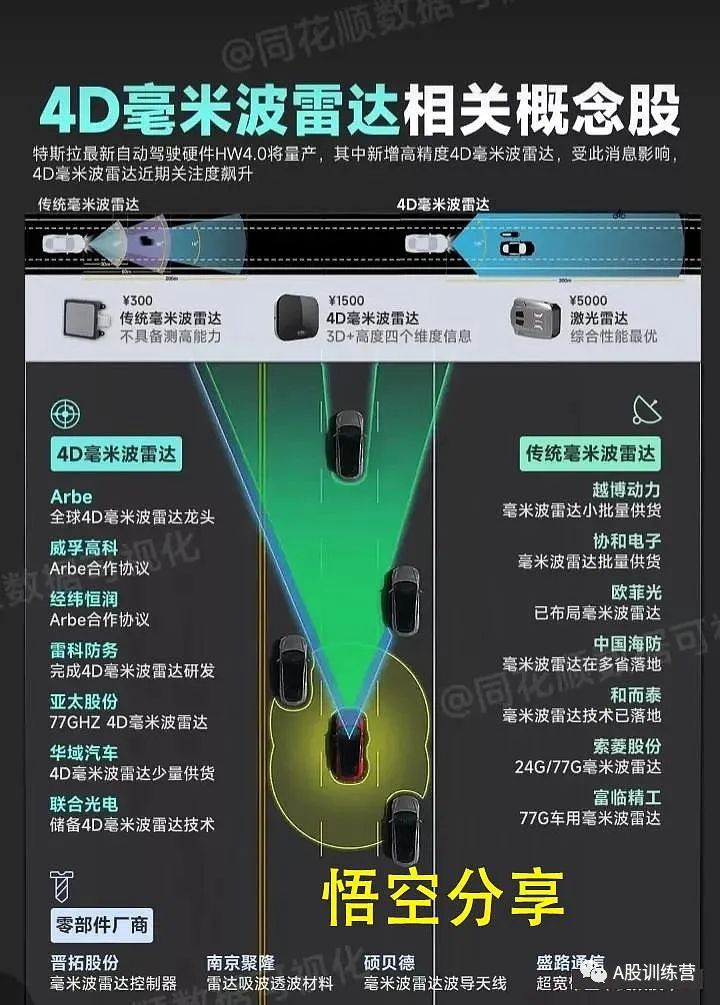

一、数字经济核心龙头股

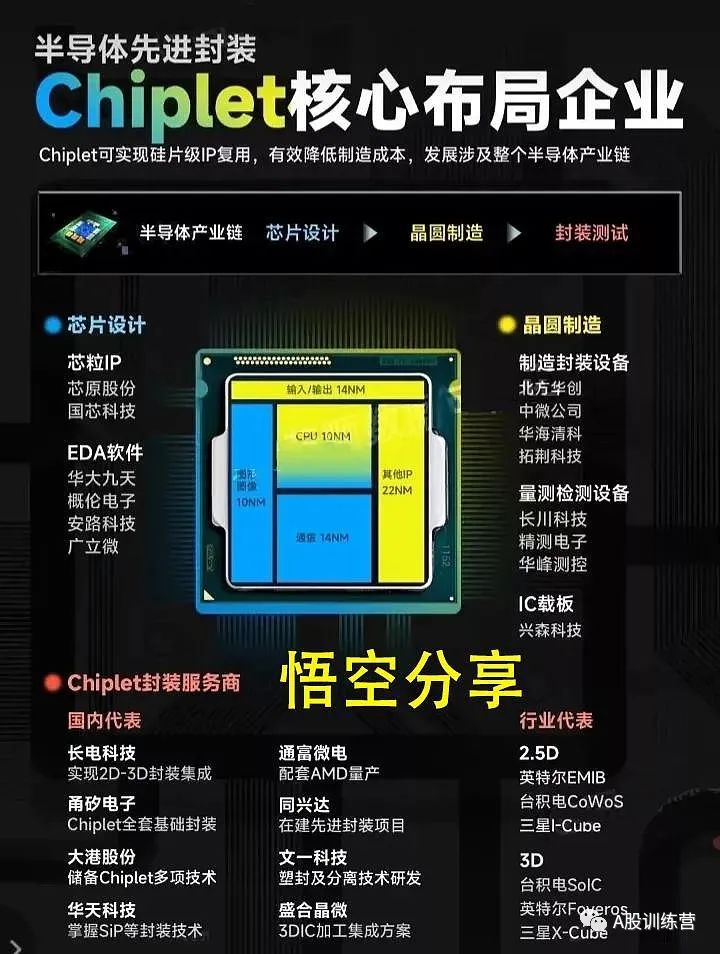

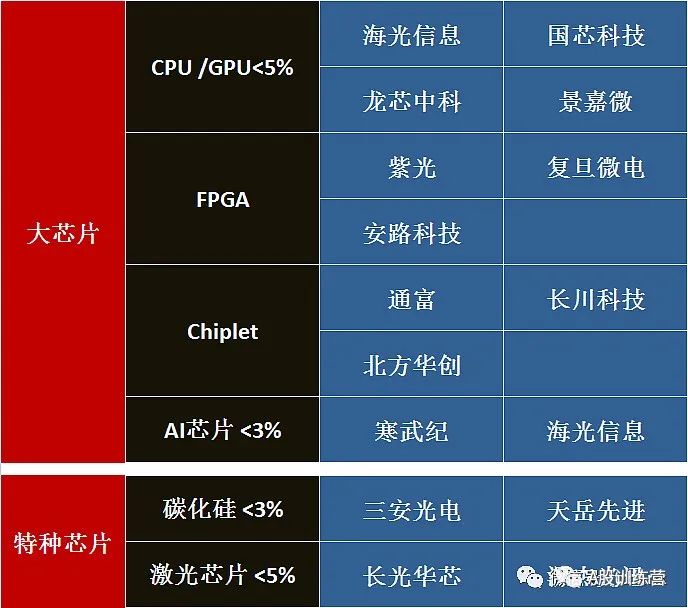

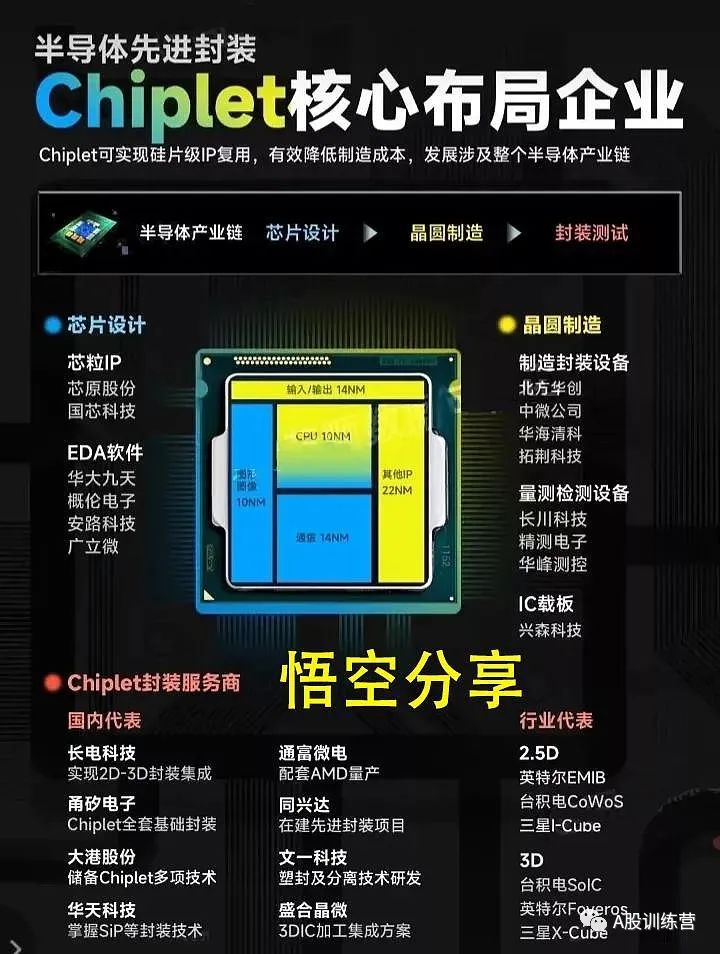

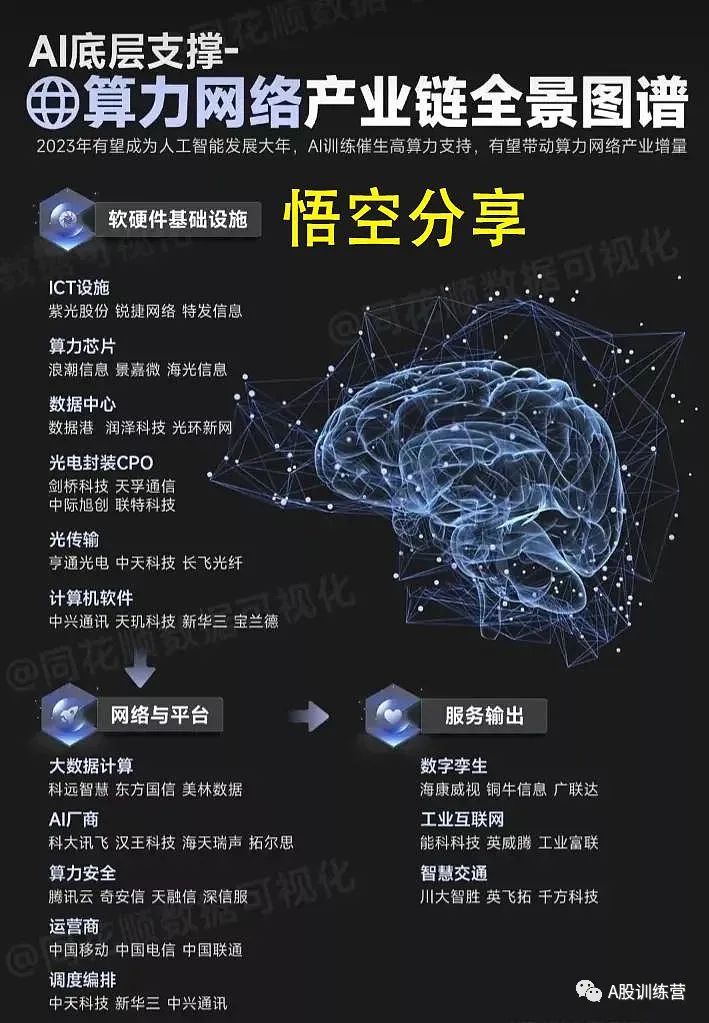

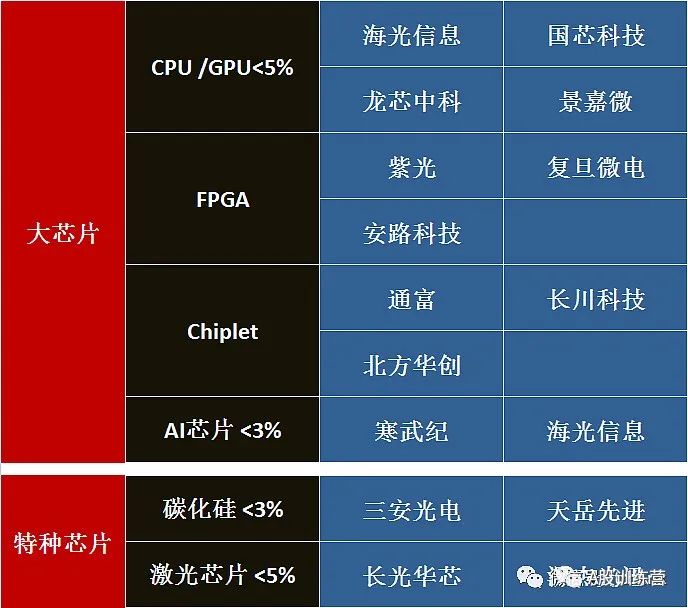

三、芯片国产替代

转自:https://mp.weixin.qq.com/s/WBAWDJO5GbeFv9trA7hgUw

分享个人经验,保留阅读记录,做时间的朋友

转自:https://mp.weixin.qq.com/s/WBAWDJO5GbeFv9trA7hgUw

来源 | 九卦金融圈综合

编辑 | 武文 张云迪

年报出炉

九卦金融圈获悉,本周开始,银行年报已进入密集披露期,其中3月31日成为银行年报披露最为密集的一日,当日有近十家银行的年报将亮相,包括交通银行、工商银行、中国银行、农业银行这些重量级选手。

之前已经有23家银行披露了业绩快报,其中有22家银行预喜。

随着各家银行的年报详单出炉,大家得以一窥各家银行2022年的“成绩”详单,下面是最近披露的建行和多家上市股份行主要成绩。

建设银行:2022年净利润增长7.06%

据上证报消息,建设银行3月29日发布的2022年年报显示,报告期内,建设银行实现归属于该行股东的净利润3238.61亿元,同比增长7.06%;实现营业收入8224.73亿元,同比下降0.22%;平均资产回报率1.00%,加权平均净资产收益率12.27%。

去年,建设银行盈利保持平稳增长。建设银行称,影响该行盈利水平主要影响因素包括:生息资产保持较好增长态势,带动利息净收入较上年增长6.22%;受外部经营环境变化等因素影响,手续费及佣金净收入较上年同比下降4.45%。报告期内,该行净利息收益率为2.02%,同比下降11个基点。

2022年,建设银行资产负债规模实现较快增长。截至报告期末,建设银行资产总额34.60万亿元,增幅14.37%;其中发放贷款和垫款净额20.50万亿元,增幅12.79%。负债总额31.72万亿元,增幅14.77%;其中吸收存款25.02万亿元,增幅11.81%。

2022年,建设银行资产质量平稳运行。截至2022年末,不良贷款余额2928.25亿元,较上年增加267.54亿元;不良贷款率1.38%,较上年下降0.04个百分点。

截至2022年末,建设银行资本充足率18.42%,一级资本充足率14.40%,核心一级资本充足率13.69%,分别较上年增长0.57、0.26和0.10个百分点。

中信银行:交出亮眼成绩单

另据界面新闻报道,“中信银行的历史包袱已经出清,从此可以轻装上阵。”3月24日,中信银行副董事长、执行董事、行长方合英在业绩会上表示。

方合英指出,中信银行连续四年把“去包袱”作为银行最重要的四大经营主题之一,通过大力的处置清收、核销和有效重组等手段,存量的历史问题得到了很好的控制化解和处置。

在前一日晚间,中信银行交出了亮眼的“成绩单”,其营收、净利润双增长,不良实现“双降”。

数据显示,2022年,中信银行实现营业收入2113.92亿元,同比增长3.34%;归属于该行股东的净利润621.03亿元,同比增长11.61%。截至2022年末,中信银行不良贷款余额652.13亿元,比上年末减少22.46亿元;不良贷款率1.27%,比上年末下降0.12个百分点。

在业绩会上,中信银行管理层围绕房地产风险敞口、绿色金融业务、信贷投放策略、地方隐性债务等热点话题,回应市场的关切。

“中信银行一季度的信贷投放已经超过了前几年每年上半年的总和,这可能有‘开门红’的因素,后期可能会慢慢趋向于稳定增长。但是整体而言,信贷需求向好,是今年的一个大的趋势。”方合英表示。

方合英还表示,将加强三个薄弱点,包括乡村振兴、普惠金融和民营企业;培育三个产品线,包括供应链融资、资本市场相关融资和科创融资;打造综合融资特色。此外,还将提升ESG可持续发展,支持制造业发展。

渤海银行:去年净利61亿 下降近30%

据澎湃新闻报道,3月29日晚,渤海银行(9668.HK)发布的2022年年报显示,该银行去年归属于母公司股东净利润为61.07亿元,同比下降29.23%;实现营业收入264.65亿元,同比下降9.35%,延续2021年10.15%的同比跌势,其中利息净收入226.69亿元,比上年下降9.97%。

具体看,渤海银行2022年利息收入616.02亿元,比上年下降1.46%;其中发放贷款和垫款利息收入470.26亿元,比上年下降3.58%;存放中央银行款项、存放同业及其他金融机构款项、拆出资金利息收入合计19亿元,比上年增长18.36%;金融投资利息收入125.24亿元,比上年增长6.54%。

截至2022年末,渤海银行资产总额1.66万亿元,比上年末增长4.85%;其中贷款和垫款总额(含贴现)9572.17亿元,比上年末增长0.19%;金融投资5445.34亿元,比上年末增长16.45%。负债总额1.55万亿元,比上年末增长4.97%,其中吸收存款总额8438.74亿元,比上年末增长2.84%。

具体看,截至2022年末,渤海银行的公司不良贷款100亿元,不良贷款率1.87%,比上年末下降0.35个百分点。资本充足情况上,截至2022年末,渤海银行资本充足率11.5%,比上年末下降0.85个百分点;一级资本充足率9.94%,比上年末下降0.82个百分点;核心一级资本充足率8.06%,比上年末下降0.63个百分点。

民生银行:不良资产处置超千亿元

据界面新闻报道,3月28日,民生银行管理层出席业绩说明会,围绕不良资产处置、营收下滑、关联贷款的情况进行交流。

前一日晚间,民生银行2022经营业绩出炉。2022年,民生银行集团实现归属于本行股东的净利润352.69亿元,增幅2.58% ;实现营业收入1424.76亿元,降幅15.60%。

截至2022年末,该行资产总额为7.26万亿元,增幅4.36%,其中,发放贷款和垫款总额4.141万亿元,增幅2.36%;负债总额6.64万亿元,增幅4.34%,其中,吸收存款总额3.99万亿元,增幅5.77%;不良贷款率1.68%,比上年末下降0.11个百分点。

“存量风险得到了化解,2020年至2022年,本行累计清收处置不良和存在风险隐患的资产超过3000亿元,存量风险基本上化解完成。”在业绩会上,民生银行执行董事、副行长袁桂军表示。

自2020年新一届领导班子上任以来,民生银行不良贷款处置问题一直备受市场关注。袁桂军介绍,三年在化解不良和存潜在风险的资产过程当中,民生银行累计实现现金清收超过1200亿元,现金回收率接近40%。其中,2022年该行清收处置不良1010亿元,不良贷款处置了840.76亿元,现金清收425亿元,超过42%。

“不良资产处置超千亿”成为了民生银行2022年的经营亮点。与此同时,该行实现了不良逾期“四降”。

数据显示,截至2022年末,该行不良贷款总额693.87亿元,比上年末减少29.51亿元 ;不良贷款率1.68%,比上年末下降0.11个百分点;逾期贷款总额823.61亿元,比上年末减少53.64亿元;逾期贷款率1.99%,比上年末下降0.18个百分点。

袁桂军还介绍,民生银行新发放贷款不良率较低,近三年、近两年和近一年,该集团公司新发放贷款不良率分别为0.42%、 0.33%和0.19%。

“前段时间,我们对泛海控股集团进行了起诉,因为(贷款)逾期的问题,根据法院的反馈,大概4月底开庭。泛海控股集团确实有风险,因此,民生银行采取了加负债权、压降敞口的策略,对存量业务追加抵押物和担保,其他的股东总体情况还是挺好。”袁桂军透露。

招商银行:总资产迈上十万亿

据深圳特区报报道,3月27日,招商银行在香港召开2022年度业绩说明会。招商银行董事长缪建民、行长王良等多位高管出席,并就投资者关心的房地产贷款、理财规模等问题一一作出回应。

“虽然我们的规模有所下降,但招银理财规模仍在行业内保持首位。”王良会上表示,招银理财的经营策略是稳定规模,不追求规模做大;优化结构,丰富产品线,加大权益类资产配置;同时提升投研能力,以夯实内功、提升能力作为今年的主要经营要求。

招商银行刚刚发布的2022年年报显示,截至2022年末,招商银行子公司招银理财管理的理财产品余额为2.67万亿元,较上年末下降3.96%。王良指出,去年银行系理财子公司由于利率波动、估值下行影响,产品跌破净值导致大量赎回带来一定流动性管理压力,招银理财也受到波及。

同时,对于备受市场关注的房地产行业风险问题,招商银行副行长朱江涛用“三升一降”来概括招行2022年表内对公房地产贷款风险。“三升”指的是,“一是去年对公房地产不良生成是138亿元,与2021年相比有大幅度上升;二是母行口径的房地产行业不良率是3.99%,比年初上升了2.6个百分点;三是整个房地产行业的拨备比例,是全行对公平均拨备比例的两倍以上”;而“一降”指的是对公房地产占对公贷款的比例是15.91%,较年初下降3个百分点。

朱江涛认为,整体来看,2022年招商银行的房地产风险得到了充分释放,同时“大概率2023年房地产行业风险会基本出清”。

年报显示,截至2022年末,该行营业收入达3447.83亿元,同比增长4.08%;归属于该行股东的净利润1380.12亿元,同比增长15.08%,继续保持两位数增长。

资产质量方面,该行不良贷款率持续在1%以下;拨备覆盖率450.79%;经营结构优势明显,零售利润贡献超过一半。在盈利性方面,招行净利息收入为2182.35亿元,同比增长7.02%。此外,招行非利息净收入仅同比略降0.62%至1265.48亿元,在营收中占比仍超过36%。

值得一提的是,截至2022年末,招行总资产达10.14万亿元,迈上10万亿新台阶,较上年末增长9.62%;总负债为9.18万亿元,较上年末增长9.56%。而这也是业内首家资产规模突破10万亿的股份行。

浙商银行:营收增速稳居全国股份行首位

据齐鲁晚报消息,3月27日,浙商银行公布2022年度业绩报告,营收、存贷款增速均居全国性股份行前列,不良贷款率五年来首次下降。

截至报告期末,资产总额达2.62万亿元,比上年末增长14.66%;全年实现营业收入610.85亿元、增长12.14%,增速稳居全国性股份行第一;实现归属于本行股东的净利润136.18亿元,增长7.67%。全年发放贷款和垫款总额1.53万亿元,比上年末增长13.20%。吸收存款1.68万亿元,增长18.77%。各项贷款和各项存款增速分列全国性股份行第一、第二。

报告期末,不良贷款率降至1.47%,比上年末下降0.06个百分点,新增业务不良率生成率持续下降,拨备覆盖率升至182.19%,较上年末上升7.58个百分点。

年报显示,该行线上渠道交易替代率99.75%,2022年个人网上银行证书客户数164.46万户,较年初增长4.84%,个人手机银行客户数516.11万户,较年初增长12.74%。截至报告期末,客户通过手机银行办理各类业务10467.67万笔,交易金额10579.1亿元。

履新后首次亮相!

光大银行新行长:今年将启动“大工程”

3月27日,光大银行行长王志恒履新后首次亮相该行业绩发布会。

据券商中国报道,日前,光大银行披露的2022年年报显示,去年该行实现净利润450.4亿元,同比增长3.2%;实现营收1516.3亿元,同比下降0.73%,截至去年末,该行资产总额已突破6.3万亿元。

“去年受国际形势的影响,疫情的反复冲击,以及利率下行带来的息差收窄,包括四季度债市的波动可能都是我们营收普遍放缓叠加的因素”,在谈及该行营收时,王志恒表示,一些非经常性的收入因素导致该行去年营收负增长,如果不算这些因素,营收是微正的,与行业整体的形势和困难基本一致。

对于未来如何改善经营效益,王志恒表示,光大银行未来将从向市场要效益、向管理要效益、向改革要效益和向风险要效益四个方面提升市场竞争力,实现高质量发展。

光大银行2022年年报显示,去年该行营业收入同比下降0.73%。拆解营收构成,去年该行利息净收入1136.55亿元,同比增长1.34%;手续费及佣金净收入267.44亿元,同比下降2.09%。

资产端来看,截至去年末,光大银行贷款总额达3.57万亿元,较年初增加2650亿元,增长8.0%,在资产中占比达56.7%,较年初提升0.7个百分点。在负债端,该行客户存款余额39171.68亿元,比上年末增加2414.25亿元,增长6.57%。息差水平来看,去年光大银行该项指标有所收窄,这也对营收造成一定压力。数据显示,净利息收益率2.01%,同比下降15个BPs。

对于后续如何改善经营效益,王志恒介绍了该行四个方面的布局:向市场要效益、向管理要效益、向改革要效益和向风险要效益。

零售AUM是该行另一关键指标,去年该行该项指标达2.42万亿元,比上年末增长 14.21%;零售存款、零售信贷规模均站上 1 万亿元大关。整体来看,光大银行零售金融去年实现营收659.86亿元,同比增长4.17%,零售营收占比达43.52%,同比提升2.05 个百分点,创近年来新高。

“必须坚持数字化经营,持续推进数字化转型”王志恒表示,围绕数字化转型光大银行将发展数字化获客、数字化产品、数字化风控、数字化渠道、数字化运营,同时把服务融入更多的生产生活的场景,形成开放的数字化生态体系。为此,该行在科技投入和人员建设方面进一步加大。

王志恒还透露,今年光大银行还将启动核心系统升级工程。“这也是我们今年科技赋能,加强科技基础设施建设的重要工作。依托科技与业务的深度融合和数据的深度挖掘,为我们财富管理银行的建设能够更好地赋能。”他表示。

平安银行:经营业绩稳健增长

据深圳晚报报道,3月9日,平安银行发布了2022年年度业绩报告。2022年,该行实现营业收入1798.95亿元,同比增长6.2%;实现净利润455.16亿元,同比增长25.3%,零售AUM接近3.6万亿元,关键风险指标保持稳定。

同时,该行持续加大实体经济支持力度,优化信贷结构,普惠、制造业、涉农、绿色金融等领域贷款实现较好增长。

报告显示,2022年末,该行管理零售客户资产(AUM)35872.74亿元,较上年末增长12.7%,其中私行达标客户AUM余额16207.85亿元,较上年末增长15.3%;个人存款余额10349.70亿元,较上年末增长34.3%。2022年末,对公客户数61.59万户,较上年末增加10.55万户,增幅20.7%;对公开放银行服务企业客户50,968户,较上年末增长68.2%;企业存款余额22777.14亿元,较上年末增长3.9%。2022年,该行主要做市交易品种的交易量和市场份额均保持市场前列,其中债券交易量的市场份额为3.2%,同比上升0.9个百分点;“平安避险”外汇避险业务交易量335.66亿美元,同比增长54.0%。

资产质量保持平稳。该行积极应对宏观经济环境变化,加强资产质量管控,推动风险防范和化解。2022年末,不良贷款率1.05%,较上年末微升0.03个百分点;逾期贷款余额占比1.56%,较上年末下降0.05个百分点。

转自:https://mp.weixin.qq.com/s/mW2MtTsBR2u2XKbGRTH7sA

只是和此前不同的是,投资人对于超高收益的预期应该下降,在风险上也要做更多的考量。

投资需要有“打破砂锅问到底”的精神

投资需要有“打破砂锅问到底”的精神

– 小彩蛋 –

聪投组建了媒体转载群,如有转载需要,请添加小编微信【fanxiaocom】,入群前请【备注新媒体名和姓名】

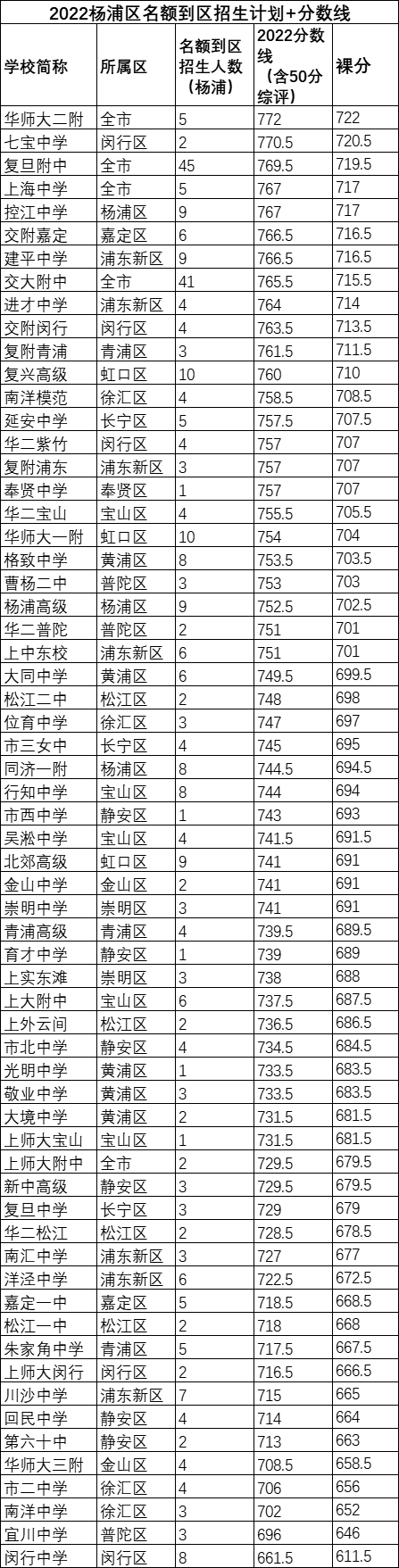

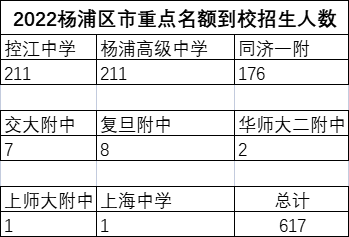

杨浦2022中考人数约6500人

以下数字为裸考数字,不包含自招的

全市68所市重点在杨浦招生人数总计:1353人,杨浦区中考市重点率约为20.81%;

市重点在杨浦招生人数包含:名额到区347人+名额到校617人+1-15志愿389人

四校在杨浦总计招生96+18+4=118人,裸考四校率约为1.81%

注:去年因为疫情原因导致高中线下综评不能展开,所以志愿填名额到区的所有人的综评分都是50分,下图以最后一列的裸分为参考

14所区重点在杨浦2022年总计招生人数约2134人,杨浦区中考区重点率约为53.6%

杨浦区9所区重点在杨浦总计招生人数2112人

外区5所区重点在杨浦总计招22人

23所普高在杨浦2022年总计招生人数约262人,杨浦区中考普高率约为57.67%

杨浦区1所普高在杨浦总计招生人数128人

外区22所普高(含民办)在杨浦总计招134人

转自:https://mp.weixin.qq.com/s/ClXEBMhoT_v0riwlpvOvEg